¿Buscas nuestro logo?

Aquí te dejamos una copia, pero si necesitas más opciones o quieres conocer más, visita nuestra área de marca.

Conoce nuestra marca.

Conoce nuestra marca.

¿Buscas nuestro logo?

Aquí te dejamos una copia, pero si necesitas más opciones o quieres conocer más, visita nuestra área de marca.

Conoce nuestra marca.

Conoce nuestra marca.

techbiz

Manuel Zaforas 21/09/2017 Cargando comentarios…

En los últimos tiempos se está oyendo hablar cada vez más sobre inteligencia artificial, dispuesta a quedarse ya en nuestras vidas.

La encontramos en nuestras casas, al alcance de la mano, en televisores, domótica, apps… las empresas cada vez la usan más en diferentes campos como la atención al cliente o el estudio del comportamiento de los mismos.

Algunos hablan ya de una nueva revolución industrial, pero ¿cómo hemos llegado a este punto?, ¿cuál ha sido la historia de la evolución de la Inteligencia Artificial? ¿qué acontecimiento y tecnologías han hecho posible que estemos finalmente en la época dorada de la IA?

El origen de la Inteligencia Artificial como disciplina data de 1956 durante un workshop que tuvo lugar en Dartmouth College. En esta cita se reunieron durante varias semanas algunos de los matemáticos y científicos más relevantes del momento, como Marvin Minsky o John McCarthy (inventor del lenguaje Lisp), que pusieron en común sus ideas y acuñaron por primera vez el término “Inteligencia Artificial”.

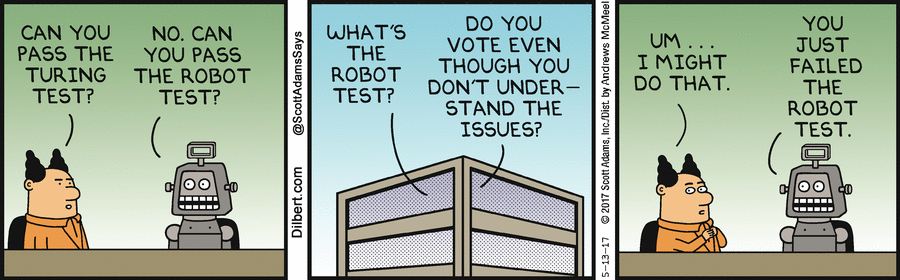

Sin embargo, podemos encontrar algunos antecedentes relevantes en la historia como el Test de Turing, desarrollado en 1950 por Alan Turing. Es aquí donde profundiza sobre la idea del pensamiento de las máquinas y cómo podríamos distinguir a un humano de un robot a través de una conversación por teleprinter.

A raíz de la conferencia de Dartmouth se disparó el interés en la investigación en inteligencia artificial. Algunos de los primeros resultados fueron impresionantes, como los avances en procesamiento del lenguaje natural o los sistemas de resolución de problemas basados en heurísticas. Las expectativas eran muy altas y la inversión se multiplicó, agencias como DARPA invirtieron millones de dólares de la época en este campo.

Sin embargo, los resultados no fueron los esperados. Aunque se hicieron grandes avances académicos y se sentaron las bases de lo que vendría después, las expectativas estaban demasiado altas y no se valoró adecuadamente la dificultad de los retos que había por delante.

La tecnología estaba inmadura en muchos aspectos. Así que, a principios de los 70, llegó una crisis conocida como “el primer invierno de la inteligencia artificial”, donde la inversión cayó notablemente y los avances se ralentizaron. La mayoría de proyectos de inteligencia artificial no pasaban de ser “juguetes” o pruebas de concepto.

En los 80 el campo de la inteligencia artificial resurge con un nuevo impulso, fundamentalmente liderado por el empuje de los “sistemas expertos” que, gracias a complejos motores de reglas, pretendían modelar el conocimiento de un experto en un área muy concreta.

Estos sistemas sí que tuvieron implantación en el mundo empresarial, pero su aplicación fue muy limitada y no tuvieron un gran impacto en la vida de las personas, estaban muy lejos de las aplicaciones que el cine imaginaba en aquella época con películas como '2001: una odisea del espacio' o 'Blade runner'.

De este modo llegó el “segundo invierno”, donde había un gran escepticismo sobre si las aplicaciones reales podrían tener o no inteligencia artificial.

En los 90 los avances no fueron especialmente significativos y tuvieron escasa aplicación en productos o servicios reales. Podemos destacar la victoria de Deep Blue de IBM contra Kasparov, el campeón del mundo de ajedrez, como uno de los eventos más reseñables.

Sin embargo, algo estaba cambiando. Era el comienzo de la era de Internet y el nacimiento de grandes empresas, como Google o Amazon, y nuevas tecnologías libres, como GNU/Linux, marcarían la diferencia y cambiarían el mundo.

Finalmente en torno al 2010 sucedieron varios eventos que tuvieron un impacto radical en la historia de la inteligencia artificial.

El primero de ellos fue el despegue definitivo de las tecnologías Cloud, que se impuso como el nuevo paradigma donde construir los productos digitales. En muy pocos años teníamos una capacidad de cómputo y de almacenamiento enormes a un coste muy asequible y con un mínimo esfuerzo.

Por otro lado, surgió todo un nuevo ecosistema de tecnologías Big Data. Nuevas herramientas, que apoyadas en esta capacidad de almacenamiento y cómputo, eran capaces de ingerir y procesar grandes volúmenes de datos, en ocasiones desestructurados, a gran velocidad.

La generalización de mobile, IoT o las redes sociales han puesto a nuestro alcance nuevas y enormes fuentes de datos. Y gracias a Big Data tenemos la capacidad de aprovecharlas.

Por último, Internet ha permitido trabajar de una manera mucho más ágil, así como colaborar y difundir el conocimiento. Gracias al open source y el open data tenemos a nuestro alcance datos y algoritmos que hace poco parecían ciencia ficción.

Estas grandes disrupciones han hecho que la investigación y los avances en inteligencia artificial se hayan disparado en los últimos años. En concreto en el área de Machine Learning y Deep Learning, donde los algoritmos son capaces de aprender de los datos y realizar tareas inteligentes como clasificar, predecir o reconocer patrones.

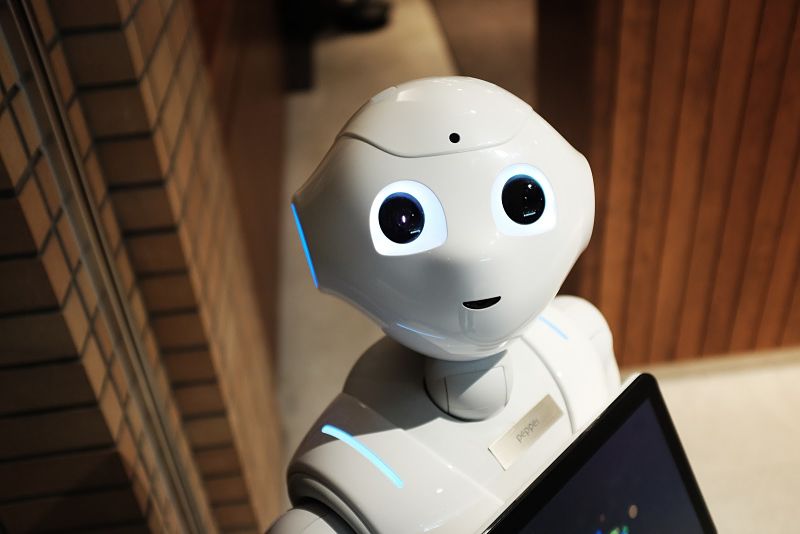

Las grandes empresas tecnológicas como Google, Amazon, Facebook o Microsoft están apostando muy fuerte en esta línea y, en los últimos años, estamos viendo avances reales en productos y servicios del día a día, por ejemplo los asistentes de voz inteligentes como Siri o Alexa, o los vehículos y drones autónomos o asistidos como los de Google o Tesla.

Parece que por fin la inteligencia artificial ha llegado su punto de madurez. Cada día que pasa surgen nuevas aplicaciones fascinantes, pero también nuevos temores e incertidumbres. ¿Hasta dónde llegará la inteligencia de las máquinas?, ¿en el futuro los trabajos serán realizados por máquinas inteligentes o surgirán nuevos trabajos para las personas gracias a la inteligencia artificial?, ¿podría ser un peligro para el ser humano la inteligencia artificial?

Mucho se ha especulado en la literatura o el cine sobre estos temas durante el siglo XX, pero la diferencia hoy en día es que el debate no es ciencia ficción, sino que está en la calle. Un buen ejemplo son los diferentes puntos de vista y la discusión que mantienen Mark Zuckerberg, fundador de Facebook y Elon Musk, fundador de Tesla y SpaceX, sobre el tema en las redes sociales.

Otras personalidades relevantes como Bill Gates y Steven Hawking se han unido a este debate público. Sin duda hay aspectos éticos que debemos tener en cuenta en el debate y riesgos que no podemos obviar.

Los comentarios serán moderados. Serán visibles si aportan un argumento constructivo. Si no estás de acuerdo con algún punto, por favor, muestra tus opiniones de manera educada.

Cuéntanos qué te parece.