¿Buscas nuestro logo?

Aquí te dejamos una copia, pero si necesitas más opciones o quieres conocer más, visita nuestra área de marca.

Conoce nuestra marca.

Conoce nuestra marca.

¿Buscas nuestro logo?

Aquí te dejamos una copia, pero si necesitas más opciones o quieres conocer más, visita nuestra área de marca.

Conoce nuestra marca.

Conoce nuestra marca.

dev

Manuel Zaforas 18/04/2016 Cargando comentarios…

Desde hace un tiempo se viene oyendo con fuerza el término Machine Learning en la industria. Cada vez las empresas están más interesadas en estas técnicas y en cómo usarlas para extraer conocimiento de sus datos y obtener una ventaja competitiva.

Dentro del universo Big Data y, concretamente, del mundo Data Science, las técnicas de Machine Learning están tomando protagonismo y van a convertirse en un elemento clave en los próximos años. Pero, ¿qué es realmente Machine Learning? ¿En qué consiste?

Machine Learning es una rama dentro del campo de la Inteligencia Artificial. El término se viene manejando desde los años 50, pero ha sido en los últimos años cuando ha tomado gran relevancia gracias al enorme aumento de la capacidad de cómputo y al gran volumen de datos que las empresas empiezan a manejar.

En este sentido, lo que nos aporta es un conjunto de algoritmos catalogados como de Machine Learning o de Aprendizaje Automático cuyo objetivo es dotar a los computadores de la capacidad de aprender sin la necesidad de ser explícitamente programados.

Tradicionalmente los algoritmos se han venido clasificando en dos grandes grupos:

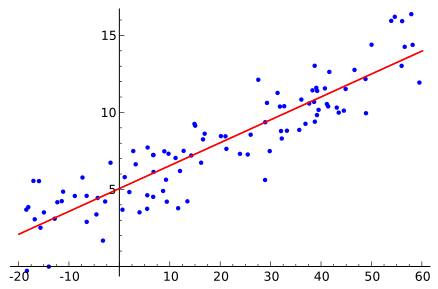

Este tipo de algoritmos se basa en que tenemos una experiencia o conocimiento previo en el que nos podemos apoyar para hacer predicciones o tomar decisiones. Por ejemplo en un sistema de control de SPAM, donde el usuario indica los correos electrónicos que son SPAM y el sistema aprende de ello para ser capaz de identificar nuevos correos de SPAM en el futuro.

Otro ejemplo podría ser un sistema de clasificación de enfermedades donde podemos basarnos en el conocimiento previo de los síntomas y características de ciertas enfermedades para que nuestro sistema aprenda y reconozca esas enfermedades en el futuro.

Para que estos algoritmos puedan funcionar correctamente debemos ser capaces de alimentarlos con un buen conjunto de datos de entrenamiento hasta conseguir el nivel de acierto que buscamos.

Algunos de los algoritmos supervisados más relevantes son:

La fuente es http://scikit-learn.org/

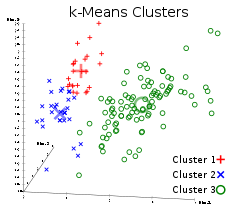

En el aprendizaje no supervisado no tenemos un conocimiento previo de los datos recibidos, de manera que este tipo de algoritmos tratan de buscar estructuras o patrones en los datos.

Un ejemplo de una aplicación interesante de estos algoritmos es la segmentación de clientes, donde podemos agrupar los clientes en grupos de forma automática en función de ciertas características comunes.

Otro ejemplo podría ser el análisis de relaciones en redes sociales, sacando patrones de las relaciones e interacciones entre los usuarios para detectar tendencias e influencias o comportamientos.

Por último, un ejemplo más clásico sería el análisis de datos científicos. Imaginemos un gran volumen de datos astronómicos donde no tenemos un conocimiento previo y lo que tratamos es de buscar patrones o anomalías.

Algunos de los algoritmos más representativos de aprendizaje no supervisado son:

Fuente: Wikipedia.org

Hoy en día tenemos multitud de frameworks y herramientas que incluyen estos y otros algoritmos de Machine Learning, preparados para ser aplicados rápidamente en problemas reales. Muchas de estas herramientas están integradas dentro de las plataformas de Big Data y orientadas a procesar de forma paralela y distribuida grandes volúmenes de datos. Algunos de los ejemplos más reseñables son:

Las técnicas de Machine Learning abarcan un campo muy grande, son una parte muy relevante dentro del universo Big Data y cada vez lo serán más. El número de técnicas y algoritmos es muy extenso y sigue evolucionando, las aplicaciones son inimaginables.

hbspt.cta.load(2189055, '52a4efa6-cb9a-49ca-9f73-fd62c006ae22', {});

Los comentarios serán moderados. Serán visibles si aportan un argumento constructivo. Si no estás de acuerdo con algún punto, por favor, muestra tus opiniones de manera educada.

Cuéntanos qué te parece.