¿Buscas nuestro logo?

Aquí te dejamos una copia, pero si necesitas más opciones o quieres conocer más, visita nuestra área de marca.

Conoce nuestra marca.

Conoce nuestra marca.

¿Buscas nuestro logo?

Aquí te dejamos una copia, pero si necesitas más opciones o quieres conocer más, visita nuestra área de marca.

Conoce nuestra marca.

Conoce nuestra marca.

dev

José Luis Palomino Hace 18 minutos Cargando comentarios…

Pensamos que los algoritmos son entes objetivos y matemáticamente puros. Nada más lejos de la realidad. Cuando delegamos tareas cotidianas a sistemas automáticos olvidamos que están construidos sobre un historial humano lleno de prejuicios. Bajar a la tierra estos modelos revela un problema técnico grave: la tecnología trae consigo estereotipos si no auditamos exhaustivamente su diseño base.

Las herramientas de procesamiento de lenguaje natural actúan a menudo como una caja negra inaccesible para el usuario medio. Introducimos una frase, esperamos una fracción de segundo y obtenemos un resultado aparentemente preciso.

El problema surge cuando analizamos casos límite donde intervienen lenguas con estructuras radicalmente distintas. Un ejemplo de este tipo de lenguas es el turco. El turco carece de género gramatical marcado para profesiones, mientras que el español obliga estructuralmente a definirlo.

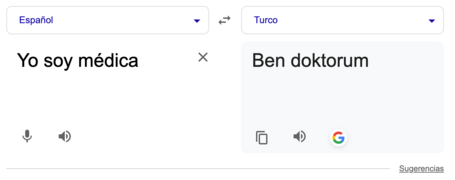

Para nuestra demostración, usaremos la herramienta de Google “Google Translate”. Si escribimos "yo soy médica" y lo pasamos al turco obtenemos "Ben doktorum". Hasta aquí todo correcto porque la expresión engloba a cualquier persona que ejerce la medicina.

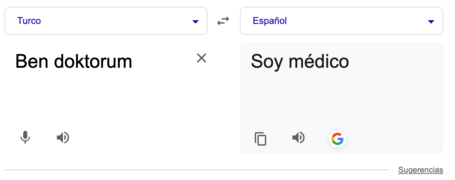

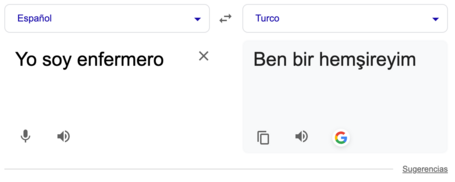

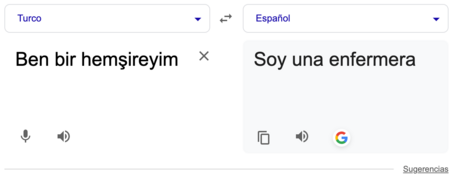

El fallo del sistema aparece cuando la traducción se realiza a la inversa. Al traducir "Ben doktorum" de nuevo al español, la plataforma nos devuelve "Soy médico". El sistema ha eliminado el género original introducido por el usuario. Esto mismo ocurre con el término “enfermero”, que al pasar por el filtro neutro y volver a nuestro idioma se transforma automáticamente en “enfermera”. Nos encontramos ante un bucle sin fin donde la máquina reescribe la identidad del usuario basándose puramente en suposiciones probabilísticas.

Ejemplo con "yo soy médica":

Ejemplo con "yo soy enfermero":

Entender este comportamiento exige conocer las tripas de los sistemas de aprendizaje automático. Los motores de traducción modernos no operan mediante un diccionario estático de reglas gramaticales fijas programadas a mano. Funcionan ingiriendo cantidades masivas de texto procedentes de internet, libros digitalizados y repositorios de documentos históricos. Los algoritmos calculan probabilidades estadísticas basadas en miles de millones de interacciones pasadas para predecir cuál es la traducción más plausible.

Aquí es donde la estadística nos juega una mala pasada. Históricamente, la palabra equivalente a "doctor" aparece rodeada de pronombres y contextos masculinos en la inmensa mayoría de los corpus de entrenamiento. La palabra "nurse" o sus derivadas sufren exactamente el mismo destino asociadas a la terminología femenina.

Cuando el modelo se enfrenta a la ambigüedad de un idioma neutro debe tomar una decisión y siempre optará por el camino matemáticamente más probable según sus datos de entrenamiento. Esta mecánica muestra sesgos sociales preexistentes porque la máquina asume que el pasado dicta la norma estricta del presente.

Desde una perspectiva puramente de negocio, lanzar productos basados en modelos no supervisados supone un gran riesgo para la empresa. Construir soluciones digitales que invisibilizan a una parte de tus usuarios genera fricción y rompe la confianza en el producto.

Imagina un software de recursos humanos que clasifique automáticamente currículums descartando a mujeres ingenieras simplemente porque su modelo de lenguaje asocia la ingeniería con perfiles masculinos. La calidad del dato de entrada determina irremediablemente el éxito o el fracaso comercial de cualquier iniciativa basada en inteligencia artificial.

Las grandes tecnológicas conocen perfectamente este comportamiento anómalo. Hemos visto intentos de mitigar el impacto mediante parches visuales en la interfaz de usuario. Al traducir frases simples del inglés al español a veces aparece un selector que ofrece ambas alternativas de género. Las capturas que analizamos hoy demuestran que estas soluciones superficiales no escalan bien. Cubrir todas las combinaciones idiomáticas y todas las estructuras sintácticas posibles mediante reglas excepcionales preprogramadas es una quimera técnica muy compleja de solucionar.

Para aportar valor a las organizaciones necesitamos arquitecturas de datos limpias y algoritmos auditables desde su concepción. Los equipos de ingeniería de datos deben incorporar métricas de equidad durante la fase de validación de los modelos antes de desplegarlos en entornos de producción reales. Evaluar continuamente el rendimiento estadístico frente a grupos demográficos es el único camino para construir tecnología robusta.

El procesamiento del lenguaje natural contemporáneo se apoya fuertemente en representaciones vectoriales del texto. Cada palabra se mapea en un espacio multidimensional donde la distancia entre vectores determina su relación semántica. Si visualizamos este espacio geométrico, observamos que la distancia vectorial entre hombre y médico es significativamente menor que la distancia entre mujer y médica. El modelo simplemente recorre el trayecto más corto en su mapa matemático.

Corregir esta desviación requiere técnicas avanzadas de mitigación de sesgos durante el preentrenamiento. Existen métodos matemáticos para aislar las dimensiones de género respecto a las dimensiones de profesión dentro de estos espacios vectoriales. Obligamos al algoritmo a desaprender esa correlación inyectando ruido controlado o penalizando la función de cálculo cuando detectamos predicciones basadas exclusivamente en estereotipos demográficos.

Integrar prácticas ágiles conscientes del sesgo permite monitorizar la degradación de estos sistemas en tiempo real. Cuando implementamos procesos de entrega continua para modelos de lenguaje necesitamos pruebas automatizadas que evalúen específicamente estas traducciones problemáticas. La tecnología debe adaptarse a la diversidad de los usuarios en lugar de forzarlos a encajar en las limitaciones estadísticas de una base de datos mal balanceada.

La adopción masiva de modelos de lenguaje nos exige elevar nuestro nivel de exigencia técnica y operativa. Delegar la semántica a sistemas no supervisados tiene consecuencias directas sobre la usabilidad de nuestros productos digitales y la reputación corporativa.

Referencias y enlaces

Los comentarios serán moderados. Serán visibles si aportan un argumento constructivo. Si no estás de acuerdo con algún punto, por favor, muestra tus opiniones de manera educada.

Cuéntanos qué te parece.