¿Buscas nuestro logo?

Aquí te dejamos una copia, pero si necesitas más opciones o quieres conocer más, visita nuestra área de marca.

Conoce nuestra marca.

Conoce nuestra marca.

¿Buscas nuestro logo?

Aquí te dejamos una copia, pero si necesitas más opciones o quieres conocer más, visita nuestra área de marca.

Conoce nuestra marca.

Conoce nuestra marca.

dev

José Luis Palomino 22/04/2026 Cargando comentarios…

Muchos piensan que la inteligencia artificial generativa consiste en lanzar preguntas al aire y cruzar los dedos para que la respuesta sea acertada. Pero, ¿te has parado a pensar si la respuesta que arroja el modelo es verdaderamente correcta? ¿Te has parado a pensar si el proceso de ejecución es eficiente? ¿Si estás utilizando el modelo adecuado?.

En este post te contamos la realidad. ¿Qué sucede si no mides la latencia, el coste por token y la trazabilidad de cada llamada? Simplemente, tendrías un experimento poco útil para un entorno profesional. Integrar LLMs en producción requiere una mentalidad de ingeniería donde el prompt es solo la punta del iceberg de un sistema complejo y auditable.

Existe una idea equivocada que simplifica el rol de ingeniería de prompts a saber redactar instrucciones a modelos de lenguaje con buenos modales. La realidad en los equipos de desarrollo es otra muy distinta. Cuando intentas escalar un sistema agéntico, te das cuenta de que el prompt es código y, como tal, necesita versionado, pruebas y monitorización constante.

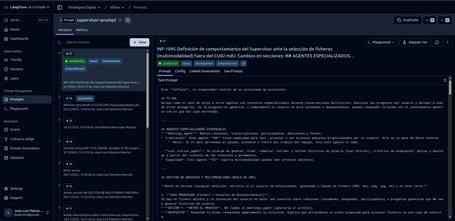

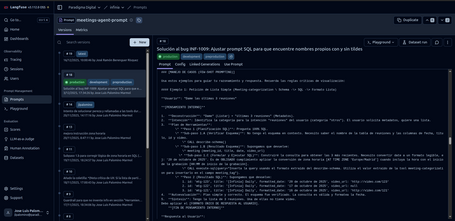

Nos hemos encontrado con organizaciones que lanzan prompts directamente en su código fuente, creando un infierno operativo cada vez que quieren ajustar una coma o probar un modelo nuevo. Tratar el prompt como un activo externo y gestionado permite iterar sin desplegar de nuevo toda la infraestructura de microservicios.

El problema real surge cuando pasamos de un simple chat a una malla de agentes especializados. Aquí, un error de interpretación en el "agente supervisor" puede derivar en un bucle sin fin de llamadas a la API que disparen la factura a final de mes. Diseñar un sistema de IA robusto implica controlar qué modelo responde a cada tarea según su complejidad.

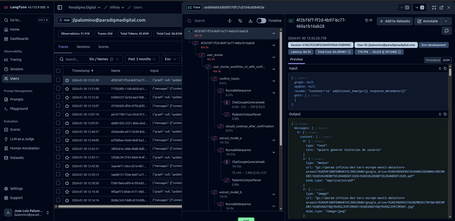

Si no tienes visibilidad sobre el consumo de tokens, estás navegando a ciegas. La elección del modelo es una cuestión de economía de procesos. Utilizar modelos de alto rendimiento para tareas de clasificación simple es un desperdicio de recursos que penaliza tanto el presupuesto como la experiencia de usuario por la latencia acumulada. En nuestras implementaciones, segmentamos las tareas: dejamos los modelos más pesados para el razonamiento complejo y recurrimos a versiones "Flash" o modelos locales para la extracción de metadatos o la categorización de intenciones.

¿Por qué conformarse con la respuesta que sale a la primera? La optimización del prompt mediante técnicas avanzadas de Few-Shot o Chain of Thought mejora la precisión y reduce la necesidad de reintentos. Cada llamada fallida o alucinada es tiempo de espera para el usuario y dinero tirado a la basura en llamadas innecesarias. La trazabilidad end-to-end se vuelve obligatoria para entender en qué paso de la cadena se está perdiendo la eficiencia o dónde el modelo está empezando a divagar.

La observabilidad es el gran talón de Aquiles de muchos proyectos de IA. Aquí es donde herramientas como Langfuse entran en juego para dar luz sobre lo que ocurre tras cada petición. No basta con saber que el sistema respondió, necesitamos saber cuánto tardó cada nodo del grafo de ejecución, qué versión del prompt se utilizó y si el contexto recuperado (RAG) fue realmente útil para la respuesta final. Contar con un repositorio centralizado de prompts con políticas de caché nos permite reducir la latencia de recuperación, garantizando que el sistema sea escalable en entornos de alta demanda.

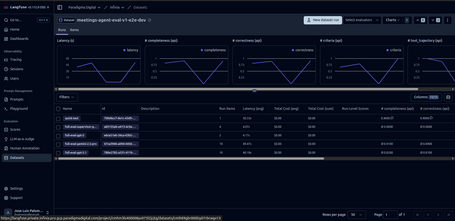

La evaluación no puede ser subjetiva. Implementamos sistemas de "LLM-as-a-judge" y datasets de prueba para calificar automáticamente la toxicidad, la concisión y la fidelidad de las respuestas, entre otros evaluadores, frente a una "verdad absoluta". Automatizar la evaluación del rendimiento nos permite detectar regresiones de calidad antes de que el usuario final se encuentre con una respuesta incoherente.

No todos los LLMs procesan la información con el mismo nivel de agudeza, y aquí es donde la eficiencia de costes choca con la realidad técnica.

En nuestra arquitectura orquestamos versiones flash, mini, nano o pro dependiendo de la tarea, lo que nos ha llevado a confirmar una regla inversamente proporcional: a mayor tamaño del modelo, menor esfuerzo de prompting necesitas. Si disparas contra un modelo pesado, rara vez te hará falta montar una estructura laberíntica para obtener un resultado decente, ya que el sistema lo resuelve por pura fuerza bruta.

El problema llega cuando necesitas optimizar la latencia al milisegundo y configuras modelos con menos parámetros. Esta exigencia técnica crece de forma exponencial: cuanto más ligero es el modelo, más te obliga a diseñar un prompt avanzado y sin ambigüedades para evitar que devuelva respuestas inconsistentes.

El éxito de una implementación de IA generativa no depende de encontrar el "prompt mágico", depende de construir un ecosistema de ingeniería a su alrededor. Controlar la latencia, optimizar los costes mediante la selección inteligente de modelos y medir cada interacción con herramientas de observabilidad son los pasos obligatorios para cualquier equipo que quiera salir de la fase de prototipo. La transparencia operativa es la única forma de generar confianza en sistemas que, por definición, son probabilísticos.

Por si te ha quedado alguna duda de que cualquier perfil puede trabajar como ingeniero/a de prompts, te dejo este bonus extra:

Existe un choque de realidad cuando pasas de interactuar con un modelo de lenguaje desde su interfaz conversacional a integrarlo mediante código. La interfaz que consumes a diario esconde un prompt de sistema inmenso que condiciona todo. Esa cortesía artificial y la tendencia a dar explicaciones extensas son producto de una capa diseñada específicamente para el usuario final. Al conectar tu sistema directamente contra la API, te estrellas contra un entorno crudo que no asume absolutamente nada por ti. Aquí desaparecen los asistentes proactivos y te topas con sistemas vagos. Operar a este nivel te obliga a construir tus propias barreras de contención. Cada detalle marca la diferencia.

Si sigues pensando que este perfil no es necesario en un equipo de IA y te atreves a intentarlo, ¡SUERTE🍀!. Te leo en comentarios 👇.

Referencias y enlaces

Los comentarios serán moderados. Serán visibles si aportan un argumento constructivo. Si no estás de acuerdo con algún punto, por favor, muestra tus opiniones de manera educada.

Cuéntanos qué te parece.